Sprint Review: der komplette Leitfaden 2026 für wirksame Scrum Sprint Reviews mit verwertbarem Feedback und klaren Product-Backlog-Entscheidungen

Die Sprint Review ist das Scrum-Event, in dem das Team das Ergebnis des Sprints anhand eines nutzbaren Increments gemeinsam mit Stakeholdern inspiziert und die nächsten Schritte aktiv anpasst. Sie dient nicht dazu, eine „schöne Demo“ zu liefern, sondern eine fundierte Produktkonversation zu ermöglichen, die Prioritäten schärft, Risiken sichtbar macht und die Ausrichtung auf das Product Goal stärkt. Eine starke Sprint Review verbindet Wert, Nutzung und Kontextveränderungen zu Entscheidungen, die unmittelbar im Product Backlog sichtbar werden. Gerade im Jahr 2026 steigen Komplexität, Abhängigkeiten und Erwartungsdruck in vielen Organisationen, wodurch ein regelmäßiger, evidenzbasierter Entscheidungsanker wichtiger wird als zusätzliche Statusmeetings. Wenn die Review gelingt, erhöht sie Vertrauen, verkürzt Entscheidungszyklen und reduziert teure Nacharbeiten, weil Annahmen früher geprüft und Widersprüche früher geklärt werden.

Was eine Sprint Review wirklich ist: Definition, Zweck und konkrete Ergebnisse

Eine Sprint Review liefert ein greifbares Ergebnis: ein aktualisiertes, präziseres Product Backlog und ein gemeinsames Verständnis darüber, was das aktuelle Increment für Nutzer, Betrieb und Business bedeutet. Im Mittelpunkt steht die Inspection des Increments, also das Prüfen realer Produktwirkung anhand echter Abläufe statt abstrakter Berichte. Direkt daran schließt die Adaptation an, nämlich das bewusste Anpassen von Prioritäten, Scope, Hypothesen oder nächsten Experimenten, damit das Team auf Signale statt auf Vermutungen reagiert. Eine gute Review schafft außerdem Transparenz über Fortschritt in Richtung Product Goal, ohne in Projektstatus-Logik abzudriften. Der Nutzen entsteht dann, wenn das Meeting nicht nur Erkenntnisse sammelt, sondern diese Erkenntnisse in Entscheidungen und Backlog-Veränderungen übersetzt.

Was eine Sprint Review nicht ist: drei Verwechslungen, die den Nutzen zerstören

Viele Teams entwerten die Sprint Review, indem sie sie als Statusmeeting durchführen, als Abnahme-Gate missbrauchen oder als PowerPoint-Show inszenieren. Ein Statusmeeting erzeugt Rechtfertigungsdruck, weil Menschen erklären, warum etwas nicht fertig wurde, statt gemeinsam zu lernen, was als Nächstes sinnvoll ist. Ein Abnahme-Gate untergräbt die Definition of Done, weil Qualität plötzlich in der Sitzung „ausgehandelt“ wird, anstatt durch klare Standards und ein wirklich fertiges Increment abgesichert zu sein. Eine Präsentationsshow reduziert die Interaktion und verhindert, dass Stakeholder das Produktverhalten real erleben, wodurch Feedback oberflächlich bleibt. Eine Sprint Review muss wie eine Arbeits- und Entscheidungsrunde wirken, in der man evidenzbasiert diskutiert und die nächsten Schritte sichtbar im Backlog verankert.

Warum Sprint Reviews Business-Ergebnisse beeinflussen: Wert, Risiko und Alignment

Die Sprint Review erhöht die Qualität von Produktentscheidungen, weil sie Spekulation durch Beobachtung ersetzt und Stakeholder mit realen Beweisen statt mit Versprechen konfrontiert. Ein funktionsfähiges Increment macht Usability-Probleme, Integrationsrisiken und Zielkonflikte sichtbar, bevor sie in Produktion oder Vertrieb eskalieren. Dadurch verkürzen sich Entscheidungszyklen, weil Stakeholder in dem Moment reagieren können, in dem Kontext, Annahmen und Trade-offs frisch und greifbar sind. Eine konsequent durchgeführte Review stärkt außerdem Vertrauen, weil Stakeholder sehen, dass Transparenz gelebt wird und Feedback nicht in Notizen versickert, sondern zu Anpassungen führt. In 2026 wird dieser Mechanismus noch wertvoller, weil Produkte häufiger Ökosysteme sind, in denen kleine Änderungen große Seiteneffekte erzeugen, und frühes Feedback die günstigste Form der Risikoreduktion bleibt.

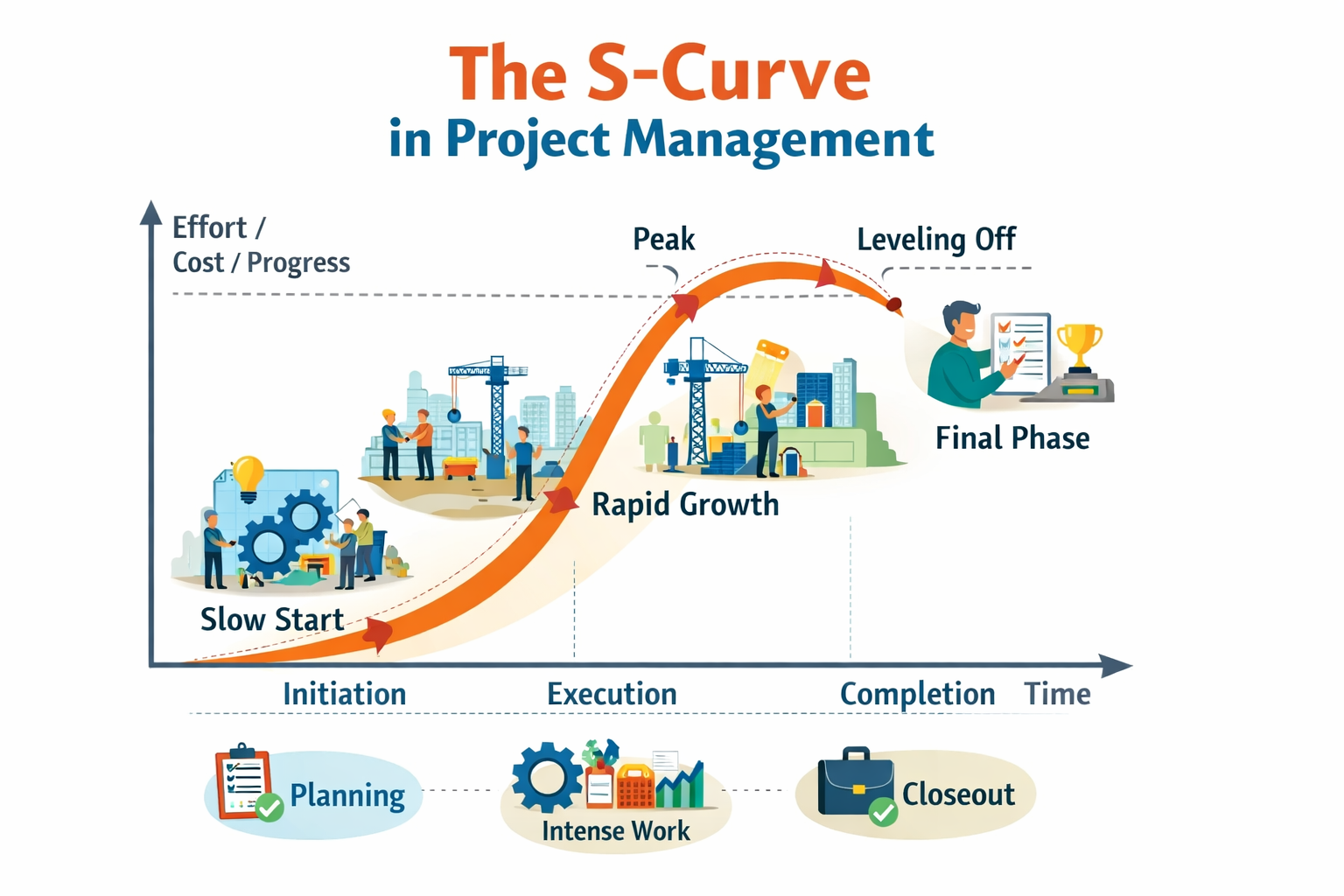

Der entscheidende Perspektivwechsel: von „mehr liefern“ zu „schneller lernen“

Eine wirklich starke Sprint Review optimiert Lernen statt Output, und dieser Fokus verändert die Auswahl dessen, was gezeigt und diskutiert wird. Statt jedes Ticket abzuhaken, wählt das Team gezielt die Teile des Increments aus, die den größten Erkenntnisgewinn versprechen, etwa kritische Nutzerflüsse, riskante Abhängigkeiten oder neue Wertannahmen. Diese Arbeitsweise verhindert das Anti-Pattern „Sprint Accounting“, bei dem endlose Demos die Aufmerksamkeit zerstören und die wichtigen Fragen untergehen. Wenn Lernen im Vordergrund steht, fordert die Review automatisch mehr Klarheit über Ziel, Nutzerwirkung und Erfolgskriterien, wodurch Backlog-Items schärfer und entscheidungsfähiger werden. Das Resultat ist ein Backlog, der weniger Wunschzettel und mehr Hypothesen, Experimente und wertorientierte Umsetzung enthält.

Teilnehmer, Rollen und Verantwortlichkeiten: wer dabei sein muss und warum

Die richtige Besetzung entscheidet darüber, ob eine Sprint Review substanzielles Feedback erzeugt oder in höflichem Schweigen endet. Die Scrum Team ist zwingend, weil nur sie das Increment verantwortet und realistisch über Machbarkeit, Kompromisse und technische Risiken sprechen kann. Die Stakeholder sollten so ausgewählt werden, dass sie Wertsignale und echte Constraints einbringen, etwa Vertrieb, Support, Operations, Compliance, Security oder Business-Verantwortliche mit Priorisierungsmandat. Zu große Teilnehmerlisten schwächen die Interaktion, weil Menschen in großen Runden seltener sprechen und Konflikte schneller politisch werden. Zu kleine Runden ohne Entscheidungsträger führen dagegen zu Feedback ohne Konsequenz, was die Motivation der Beteiligten mittelfristig senkt. Eine gute Praxis besteht darin, eine stabile Kernrunde zu etablieren und je nach Thema gezielt Experten einzuladen, die konkrete Entscheidungen ermöglichen.

Wer präsentiert was: ein Rollenmodell, das die Review präzise und glaubwürdig hält

Die Sprint Review funktioniert am besten, wenn Verantwortung für Kontext, Demo und Moderation bewusst verteilt wird, statt dass eine Person alles improvisiert. Der Product Owner rahmt den Nutzen, verknüpft das Increment mit dem Product Goal und steuert die Priorisierungsdiskussion, damit Feedback nicht in beliebige Wunschlisten abgleitet. Die Developers demonstrieren reale Produktabläufe, weil sie Details, Einschränkungen und Trade-offs präzise erklären können und damit Vertrauen schaffen. Der Scrum Master sorgt für Timeboxing, Struktur und psychologische Sicherheit, damit kritische Fragen möglich werden und Diskussionen nicht in Schuldzuweisungen kippen. Diese Aufgabenteilung erhöht die Gesprächsqualität, weil jeder aus seiner Verantwortung heraus beiträgt und Stakeholder klar erkennen, wie sie das Produkt tatsächlich beeinflussen können.

Timebox, Dauer und Taktung: wie lang eine Sprint Review 2026 sein sollte

Timeboxing schützt den Zweck der Sprint Review, weil es das Team zwingt, das Wesentliche zu priorisieren und die Diskussion auf Entscheidungen auszurichten. Scrum liefert eine klare quantitative Leitplanke: maximal 4 Stunden für einen Sprint von einem Monat, und proportional weniger bei kürzeren Sprints. Diese Zahl ist kein Zielwert, sondern ein Indikator für Reife, denn dauerhafte Überziehungen deuten häufig auf mangelnde Vorbereitung, zu viele Demo-Details oder unkontrollierte Debatten hin. Eine wirksame Review balanciert Vorführung und Diskussion so, dass Stakeholder genug Raum für Fragen haben, ohne dass das Meeting zerfasert. In der Praxis zeigt sich die richtige Dauer daran, ob am Ende Backlog-Änderungen, klare Entscheidungen oder sauber definierte Folgeanalysen stehen, statt Zeitdruck und offene Enden.

Einladungskadenz und Verlässlichkeit: warum Stabilität Teilnahme erhöht

Verlässliche Termine machen die Sprint Review zu einem planbaren Entscheidungsritual, wodurch Stakeholder die Teilnahme als Teil ihrer Arbeit statt als Störung wahrnehmen. Ein stabiler Wochentag und eine konstante Uhrzeit reduzieren Reibung, insbesondere in hybriden und verteilten Settings, in denen Meeting-Fatigue schneller entsteht. Eine frühzeitig kommunizierte Agenda mit klaren Entscheidungspunkten erhöht die Wahrscheinlichkeit, dass die richtigen Personen teilnehmen, weil sie den Nutzen sofort erkennen. Gleichzeitig entsteht durch Regelmäßigkeit ein Transparenzsignal, das Vertrauen stärkt und separate Governance-Meetings oft überflüssig macht. In 2026 ist diese Stabilität besonders wertvoll, weil parallele Initiativen und Tool-Landschaften die Aufmerksamkeit fragmentieren und nur sehr klare, wiederkehrende Formate dauerhaft bestehen.

Vorbereitung: der Hebel, der den Erfolg der Sprint Review bestimmt

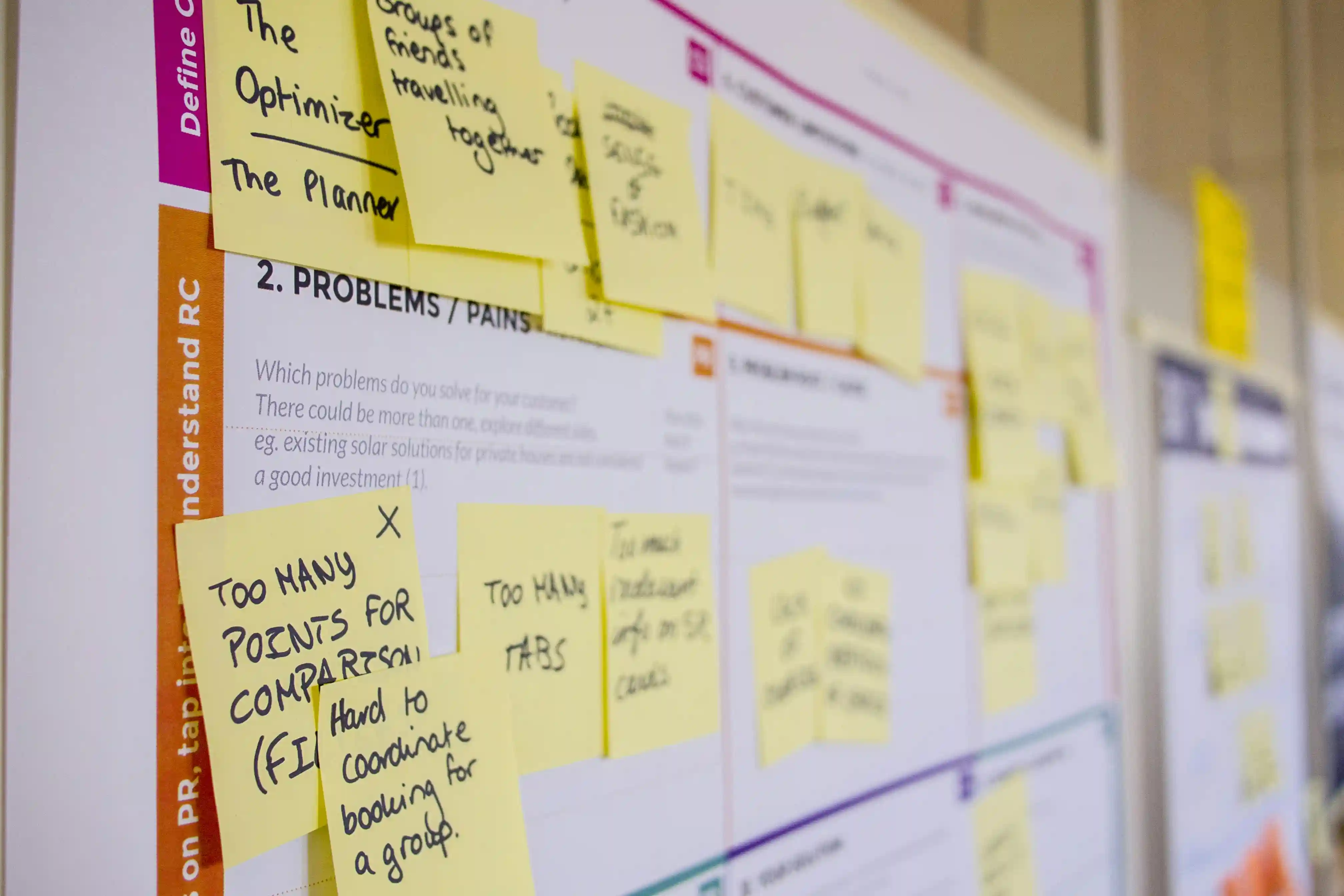

Die Qualität einer Sprint Review wird größtenteils vor dem Meeting entschieden, weil ein fehlendes Narrativ, instabile Demos oder unklare Entscheidungserwartungen in der Sitzung kaum nachholbar sind. Der erste Schritt ist die Absicherung der Definition of Done, denn ein Increment, das in kritischen Pfaden bricht, zerstört Vertrauen und lenkt die Diskussion auf Fehlerbehebung statt auf Wert und Richtung. Danach definiert das Team, was es lernen will, etwa welche Hypothesen validiert werden sollen oder welche Risiken Stakeholder früh beurteilen müssen. Anschließend wird eine Demo entlang realer Nutzerflüsse vorbereitet, weil Stakeholder Wirkung besser verstehen, wenn sie Abläufe erleben statt Story-Listen zu hören. Schließlich muss geklärt sein, wie Feedback erfasst und in Backlog-Entscheidungen übersetzt wird, damit die Review nicht als „interessantes Gespräch“ endet, das niemand weiterverfolgt.

Operative Checkliste: ein wiederholbarer Standard für konsistente Reviews

Eine Checkliste macht Sprint Reviews zuverlässig, weil sie die wichtigsten Qualitätshebel standardisiert und die Vorbereitung unabhängig von Einzelpersonen stabil hält. Vor dem Termin werden Demo-Umgebung, Zugänge und End-to-End-Flows getestet, damit keine Zeit in Troubleshooting verloren geht und das Meeting seine Energie behält. Das Team legt außerdem fest, welche Entscheidungen möglich sind und welche nur als Hypothesen oder Analyseaufträge erfasst werden sollen, damit keine überhasteten Zusagen entstehen. Zusätzlich werden drei offene Fragen vorbereitet, die Stakeholder zu verwertbarem Feedback führen, etwa zu Nutzerwirkung, operativen Risiken oder Compliance-Auswirkungen. Schließlich wird ein sichtbarer Mechanismus für Feedback und Backlog-Updates eingerichtet, damit die Gruppe am Ende nachvollziehen kann, was sich durch die Review konkret geändert hat.

- Increment-Reife: Definition of Done, Stabilität, Daten, Zugänge, Demo-Setup verifizieren.

- Auswahl: nur Inhalte zeigen, die Wert, Risiko oder Lernen maximieren und echte Fragen beantworten.

- Nutzerfluss-Skript: Demo als realistische Szenarien statt Ticket-Walkthroughs gestalten.

- Entscheidungsziele: klären, was heute entschieden werden kann und was Exploration benötigt.

- Feedback-Transfer: Themen clustern, Verantwortliche benennen, Product Backlog sichtbar aktualisieren.

Agenda mit maximalem Effekt: Struktur, die Feedback in Entscheidungen verwandelt

Eine gute Sprint Review-Agenda erzeugt Momentum, weil sie die Sitzung von Anfang an als Arbeitsrunde positioniert und den Fokus auf Wert und nächste Schritte hält. Du startest mit einem kurzen Rahmen: Sprint-Ziel, Kontext zum Product Goal und die wichtigsten Veränderungen seit dem letzten Sprint, damit alle dieselbe Ausgangslage teilen. Danach benennst du explizit, was gezeigt wird und was bewusst nicht gezeigt wird, weil diese Klarheit Zeit schützt und Erwartungsmanagement verbessert. Anschließend demonstriert das Team das Increment entlang eines oder weniger realer Use Cases, wobei die Demonstration Beweise liefert, nicht Rechtfertigungen. Danach reservierst du bewusst Zeit für Diskussion, Feedback und Konsequenzen, und du beendest die Review mit einer klaren Zusammenfassung der Backlog-Anpassungen, damit der Nutzen sichtbar und überprüfbar bleibt.

Moderationsskript: Fragen, die aus einer Demo eine Produktkonversation machen

Die Qualität von Stakeholder-Feedback hängt stark davon ab, welche Fragen du stellst, weil ungerichtete Fragen meist nur Meinungen statt Entscheidungen erzeugen. Wirksame Fragen lenken auf Ergebnis, Risiko und Nutzbarkeit, zum Beispiel darauf, was reale Nutzung verhindern würde oder welche operativen Konsequenzen ein Rollout auslöst. Gleichzeitig solltest du Feedback auf das Product Goal beziehen, damit neue Ideen nicht als unpriorisierte Nebenaufträge in den Backlog drücken. Du vermeidest es, komplexe Fragen wie große Release-Termine oder harte Zusagen zu erzwingen, wenn Daten fehlen, weil soziale Dynamik sonst zu überstürzten Commitments führt. Ein praktisches Format besteht darin, Rückmeldungen sofort in drei Kategorien zu sortieren, nämlich „sofort entscheiden“, „explorieren“ und „parken“, damit Fokus und Energie erhalten bleiben.

Feedback in Backlog-Qualität übersetzen: damit aus Worten konkrete Produktarbeit wird

Eine Sprint Review ist nur so wertvoll wie ihre Fähigkeit, Feedback in echte Anpassung zu verwandeln, denn ohne sichtbare Konsequenz sinkt Stakeholder-Beteiligung sehr schnell. Der erste Schritt ist das Strukturieren von Feedback in Bestätigung, Korrektur und Exploration, damit nicht jede Bemerkung automatisch zu einer neuen Story wird. Danach übersetzt du Rückmeldungen in die richtige Backlog-Form, etwa als Hypothese, Experiment, Spike, nichtfunktionale Anforderung oder klassische User Story, abhängig davon, was zur Validierung benötigt wird. Jeder neue Backlog-Eintrag braucht eine klare Absicht, idealerweise mit einem messbaren oder beobachtbaren Erfolgskriterium, damit das Team im nächsten Sprint prüfen kann, ob die Anpassung den gewünschten Effekt hatte. Am Ende der Review solltest du zeigen, wie sich der Product Backlog verändert, weil diese Transparenz den Stakeholdern signalisiert, dass ihr Input ernst genommen und in Steuerung übersetzt wird.

In der Sitzung entscheiden oder danach: ein einfaches Modell für saubere Entscheidungen

Eine gute Sprint Review entscheidet mutig, aber nicht impulsiv, und dieses Gleichgewicht erreichst du mit einem klaren Entscheidungsrahmen. Du entscheidest in der Sitzung, wenn die Entscheidung reversibel ist, die richtigen Personen anwesend sind und ausreichend Information vorliegt, etwa für das Umpriorisieren zweier Items oder das Klären einer fachlichen Regel. Du verschiebst Entscheidungen, wenn sie stark irreversibel sind oder zusätzliche Daten erfordern, etwa rechtliche Bewertungen, Security-Analysen oder umfassendere Nutzervalidierung. So vermeidest du Zusagen aus Gruppendruck, die später zurückgenommen werden müssen und Vertrauen beschädigen. Wichtig ist, dass du verschobene Entscheidungen als konkrete Folgeaufgaben mit Owner und Termin festhältst, damit Stakeholder sehen, dass „später“ nicht „nie“ bedeutet.

Best Practices 2026: Sprint Reviews lebendig, nutzbar und entscheidungsorientiert gestalten

Im Jahr 2026 zeichnen sich die besten Sprint Reviews dadurch aus, dass sie Interaktion fördern, Fortschritt verständlich visualisieren und am Ende sichtbare Anpassungen liefern. Wenn möglich lässt du Stakeholder das Produkt selbst nutzen, weil echtes „Hands-on“ Reibungen zeigt, die in einer Screen-Share-Demo oft verborgen bleiben. Du visualisierst Fortschritt in Richtung Product Goal mit wenigen, gut interpretierbaren Indikatoren, damit Stakeholder den Increment als Schritt auf einer Reise statt als Feature-Haufen begreifen. Du forderst Feedback als Problem- oder Outcome-Beschreibung ein, nicht als Lösungsvorgabe, weil solution-level Diskussionen schnell politisch werden und die Verantwortung des Teams verwässern. Zusätzlich schützt du die Sitzung vor Drift, indem du Off-Topic-Themen sichtbar parkst und immer wieder auf Entscheidungspunkte und Backlog-Konsequenzen zurückführst.

KI sinnvoll nutzen, ohne Feedback zu verwässern: ein realer Vorteil in 2026

KI-Assistenz kann Sprint Reviews stärken, wenn du sie für Synthese und Mustererkennung nutzt, nicht für Entscheidungen, denn Entscheidungen benötigen Kontext, Verantwortung und klare Priorisierungskriterien. Eine häufig zitierte Statistik aus 2026 stammt aus dem AI4Agile Practitioners Report: 67% der Organisationen geben Teams bereits Zugriff auf KI-Tools, was standardisierte Review-Vorbereitung und Follow-ups erleichtert. Du kannst KI einsetzen, um Notizen zu clustern, Themen zu verdichten, Vorschläge für Backlog-Formulierungen zu erstellen oder gezielte Fragen für bestimmte Stakeholder-Rollen zu generieren. Das Risiko besteht darin, dass automatische Zusammenfassungen Nuancen glätten und starke Signale in generische Aussagen verwandeln, die niemandem wehtun, aber auch nichts verändern. Nutze KI daher als Entwurfshelfer, prüfe jede Synthese gegen Originalaussagen und stelle sicher, dass jedes Thema in eine Entscheidung, ein Experiment oder ein konkretes Backlog-Item überführt wird.

Anti-Patterns: typische Fehler und klare Gegenmaßnahmen

Viele schlechte Sprint Reviews folgen denselben Anti-Patterns, die den Zusammenhang zwischen Increment, Lernen und Backlog-Anpassung zerstören. „Death by PowerPoint“ ersetzt Produktbeweise durch Erzählung, wodurch Stakeholder über eine Geschichte diskutieren statt über reales Verhalten, und Feedback spekulativ bleibt. Das Review-als-Abnahme-Gate erzeugt Angst, Verteidigung und Verhandlung, weil Qualität nicht mehr durch die Definition of Done abgesichert ist, sondern durch Meeting-Dynamik. Die Vollständigkeits-Demo, in der alles gezeigt wird, erschöpft die Aufmerksamkeit und verhindert, dass wichtige Risikofragen genug Raum bekommen. Die Gegenmaßnahmen sind klar: weniger zeigen, dafür entscheidungsrelevanter; Szenarien statt Ticketlisten; und ein Abschluss, der sichtbar macht, wie das Product Backlog sich aufgrund der Review verändert.

Schnelldiagnose im laufenden Meeting: Symptome, Ursachen, Sofortaktionen

Du erkennst eine schwache Sprint Review daran, wie Menschen sich verhalten, denn Meeting-Dynamik zeigt oft präziser als jede Theorie, wo der Zweck verloren ging. Wenn Stakeholder fernbleiben, liegt das meist an geringer wahrgenommener Wertigkeit, etwa durch zu lange Demos oder fehlende Konsequenzen, und die Sofortaktion besteht darin, Auswahl und Abschluss zu schärfen. Wenn das Team defensiv reagiert, ist die Review wahrscheinlich zu einer Bewertungsbühne geworden, und du musst sofort auf Inspection und Adaptation umrahmen, mit neutralen Fragen zu Outcome und Risiko. Wenn Stakeholder mit Requests überfluten, fehlt oft ein gemeinsames Priorisierungsmodell, und du solltest jede Idee an Product Goal und Kriterien koppeln, bevor sie in den Backlog wandert. Eine schnelle Strukturierung in „entscheiden“, „explorieren“ und „parken“ reduziert Chaos, erhöht Entscheidungsqualität und macht die Sitzung sofort ruhiger und produktiver.

Sprint Review vs Sprint Retrospective: klare Trennung für bessere Ergebnisse

Wenn Teams Sprint Review und Sprint Retrospective vermischen, entsteht meist ein hybrides Meeting, das weder echtes Produktfeedback noch ehrliche Prozessverbesserung ermöglicht. Die Sprint Review ist produkt- und stakeholderorientiert, denn sie inspiziert das Increment, diskutiert Wert und Kontext und passt den Product Backlog an. Die Retrospektive ist teamintern und prozessorientiert, denn sie untersucht Zusammenarbeit, Engpässe, Tools und Verbesserungsmaßnahmen für die Scrum Team. Werden beide Events kombiniert, verlieren Stakeholder entweder den Nutzen, weil zu viel intern besprochen wird, oder das Team verliert Sicherheit, weil heikle Themen nicht offen angesprochen werden. Halte die Events getrennt und nutze die Review als Produktsteuerung mit Beweisen, während die Retrospektive die Lieferfähigkeit und Qualität des Teams systematisch verbessert.

Wirksamkeit messen: eine Scorecard, die Sprint Reviews kontinuierlich verbessert

Das Messen einer Sprint Review bedeutet nicht Bürokratie, sondern das Prüfen, ob das Meeting tatsächlich Anpassung erzeugt und Entscheidungen verbessert. Du kannst die konstante Anwesenheit entscheidender Stakeholder als Signal nehmen, weil Abwesenheit häufig auf geringen Nutzen oder unklare Entscheidungspunkte hinweist. Du beobachtest außerdem, wie viel Feedback in Backlog-Anpassungen mündet, denn nur dann wird Lernen in Produktarbeit übersetzt. Auch das Verhältnis von Demo-Zeit zu Diskussionszeit ist aussagekräftig, weil eine Review ohne Diskussion meist nur eine Vorführung ist. Schließlich ist die sichtbare Veränderung des Product Backlog nach dem Meeting ein Kernindikator, denn ein Backlog, der sich nie anpasst, deutet entweder auf fehlendes Lernen oder auf fehlenden Mut zur Veränderung hin.

Fünf-Kriterien-Scorecard: kurz, mobilfreundlich und handlungsorientiert

Eine gute Scorecard ist so kurz, dass sie niemanden abschreckt, und so konkret, dass sie Verhalten verändert, statt nur Gefühle zu messen. Du bewertest die Klarheit von Sprint-Ziel und Product Goal-Rahmung, weil schlechte Rahmung unbrauchbares Feedback erzeugt. Du bewertest die Demo-Qualität, insbesondere ob Szenarien echte Nutzung und relevante Constraints zeigen, denn das steigert Lernwert und Stakeholder-Vertrauen. Du bewertest Feedback-Nützlichkeit, indem du prüfst, ob Rückmeldungen Outcomes, Risiken oder Einschränkungen enthalten statt bloßer Vorlieben. Du bewertest Entscheidungs-Klarheit, also ob die Runde mit einer kleinen Menge klarer Entscheidungen oder Experimente endet, die jemand verantwortet. Du bewertest schließlich die sichtbare Product Backlog-Adaptation, weil nur sie beweist, dass die Review das Produkt tatsächlich steuert.

Kontextvarianten: Sprint Reviews für B2B, komplexe Produkte, Multi-Teams und Remote

Eine Sprint Review muss sich an den Kontext anpassen, ohne ihre Kernfunktion zu verlieren, denn Stakeholder benötigen je nach Produktart unterschiedliche Beweise. In B2B-Kontexten solltest du oft account- und rolloutbezogene Szenarien zeigen, weil Wert durch Adoption, Integrationen und operative Machbarkeit entsteht. Bei komplexen Plattformen strukturierst du die Review besser nach Wertthemen und Risikobereichen als nach technischen Komponenten, damit Stakeholder Wirkung verstehen und dennoch die wichtigsten Constraints sehen. In Multi-Team-Umgebungen vermeidest du die „Demo-Parade“, indem du einen gemeinsamen Produktfaden definierst und nur die Increments zeigst, die Nutzererlebnis oder strategische Ziele tatsächlich verändern. In Remote-Settings investierst du konsequent in Tooling, Zugänge und Feedback-Kanäle, weil technische Reibung sonst die Diskussion erstickt, die eigentlich der wertvollste Teil der Review ist.

Viele Stakeholder managen: die Review vor dem „Forum“-Effekt schützen

Wenn viele Bereiche teilnehmen, wird die Sprint Review schnell zum Forum, in dem lokale Prioritäten konkurrieren, wodurch Fokus und Entscheidungskraft verloren gehen. Du verhinderst das, indem du ein gemeinsames Priorisierungsmodell etablierst, etwa nach Kundenwirkung, Umsatzpotenzial, Risikoreduktion, Compliance oder operativer Last, und jede neue Idee daran misst. Du verlangst, dass Feedback als Problem, Outcome oder Constraint formuliert wird, weil das Team sonst in Lösungskämpfen landet, die politisch werden und selten zu klaren Backlog-Items führen. Für Detailwünsche nutzt du asynchrone Kanäle, damit die Live-Review die wichtigsten Lern- und Entscheidungsfragen behält. Am Ende fasst du zusammen, was entschieden wurde, was exploriert wird und was geparkt ist, damit alle gehört wurden, ohne dass das Produkt in widersprüchliche Richtungen gezogen wird.

Fortgeschrittene Moderation: Energie in Commitment und Klarheit umwandeln

Fortgeschrittene Moderation macht die Sprint Review spürbar effizienter, weil sie die Sitzung als Arbeitsraum gestaltet und nicht als Präsentationsbühne. Du startest mit einem klaren Working Agreement, das Neugier fördert, etwa indem Kritik auf Annahmen und Risiken zielt, nicht auf Personen, was psychologische Sicherheit erhöht. Du nutzt Timeboxes pro Segment und sichtbare Übergänge, damit Diskussionen nicht unbemerkt den Fokus wechseln und am Ende keine Entscheidungen möglich sind. Du benennst eine Person, die Feedback live strukturiert und clustert, weil sonst wichtige Punkte in Chatverläufen verschwinden und nicht in den Product Backlog wandern. Wenn Konflikte entstehen, verankerst du die Debatte in beobachtbaren Effekten aus dem Increment und in vereinbarten Kriterien, weil Evidence plus Kriterien die schnellste Route aus Positionskämpfen ist.

Die Demo für Erkenntnis designen: Szenarien, Edge Cases und „Constraints zeigen“

Die beste Sprint Review-Demo zeigt nicht nur den Happy Path, sondern die Wahrheit des Produkts, weil genau diese Wahrheit für Entscheidungen entscheidend ist. Du wählst Szenarien, die reale Nutzung repräsentieren und die Frage beantworten, die du mit Stakeholdern klären willst, etwa Adoption, Prozesszeit, Risiken oder Integrationstauglichkeit. Wenn relevant, zeigst du mindestens einen Edge Case oder einen constraintgetriebenen Ablauf, weil diese Fälle spätere Produktionsprobleme oft früh ankündigen. Du kommunizierst offen, was das Increment noch nicht leistet, und erklärst warum, weil Transparenz Erwartungsmanagement verbessert und Konflikte vorbeugt. Gleichzeitig hältst du die Demo bewusst kurz, damit genug Zeit für Diskussion bleibt, denn dort entsteht Adaptation und dort wird der Product Backlog wirklich besser.

Sprint Review mit Produktstrategie verknüpfen: Product Goal, Roadmap und Outcome-Orientierung

Eine Sprint Review entfaltet maximale Wirkung, wenn sie erkennbar zur Produktstrategie beiträgt, weil Stakeholder dann nach Richtung statt nach Geschmack bewerten. Du verknüpfst das Increment mit dem Product Goal und benennst explizit, welches Outcome beeinflusst werden soll, etwa Aktivierung, Retention, Effizienz oder Risikoreduktion. Du nutzt die Review, um Roadmap-Annahmen gegen aktuelle Signale zu prüfen, denn Marktbewegungen, interne Restriktionen oder neue Erkenntnisse können frühere Pläne entwerten. Wenn Stakeholder den strategischen Zusammenhang verstehen, geben sie Feedback auf Outcome-Ebene, zum Beispiel dass ein Ablauf weiterhin zu lange dauert, statt dass sie einzelne Screens beurteilen. Diese Kopplung stärkt auch die Fähigkeit, Scope zu begrenzen, weil neue Wünsche sich gegen ein klares Ziel und gegen begrenzte Kapazität behaupten müssen, was den Backlog kohärent hält.

Fortschritt quantifizieren, ohne die Review in ein reines KPI-Meeting zu verwandeln

Stakeholder wünschen Zahlen, aber die Sprint Review sollte Metriken nutzen, um Entscheidungen zu schärfen, nicht um Reporting zu ersetzen. Du wählst wenige Indikatoren, die direkt mit dem Product Goal verknüpft sind, und du verwendest sie als Anlass für Lernfragen, etwa was sich durch das Increment verbessert hat und welche Risiken bleiben. Wenn du eine Kennzahl zeigst, verbindest du sie mit dem gezeigten Verhalten, weil Zahlen ohne Kontext schnell zu Missverständnissen führen und Diskussionen entgleisen lassen. Du vermeidest Dashboards in Überfülle, weil zu viele Metriken die Aufmerksamkeit zerstreuen und die nächste sinnvolle Aktion unklar machen. Wenn quantitative Daten noch unreif sind, nutzt du valide qualitative Signale wie Support-Themen, Sales-Einwände oder beobachtete Reibung in Nutzerflüssen, denn auch diese Evidenz kann Backlog-Entscheidungen fundieren.

Mini-FAQ zur Sprint Review: präzise Antworten auf häufige Suchfragen 2026

Was ist der Unterschied zwischen Sprint Review und Sprint Demo?

Eine Sprint Demo meint oft „zeigen, was gebaut wurde“, während die Sprint Review bedeutet „das Gebaute nutzen, um zu entscheiden, was als Nächstes passiert“. In einer reinen Demo reagieren Stakeholder häufig mit oberflächlichen Eindrücken, die selten zu klaren Backlog-Anpassungen führen, weil Ziel und Entscheidungsrahmen fehlen. In einer Sprint Review wird das Increment als Evidenz genutzt, anschließend wird strukturiert über Wert, Risiken, Constraints und nächste Schritte diskutiert, bis Product Backlog-Konsequenzen sichtbar werden. Der Unterschied zeigt sich am Ergebnis: Eine Demo endet oft ohne klare Entscheidungen, eine Sprint Review endet mit Priorisierungsänderungen, Experimenten oder definierten Folgeanalysen. Wenn nach dem Meeting weder Backlog noch Richtung angepasst sind, hat die Runde eine Demo geliefert, aber keine Review im Scrum-Sinn durchgeführt.

Wer sollte die Sprint Review leiten: Product Owner oder Scrum Master?

Am wirksamsten ist eine Rollenverteilung, in der der Product Owner den Wert- und Entscheidungsfokus führt und der Scrum Master die Effektivität des Events moderiert. Der Product Owner kann am besten den Zusammenhang zum Product Goal herstellen, Prioritäten erklären und Feedback in Backlog-Entscheidungen überführen, ohne den Blick für Wert zu verlieren. Der Scrum Master schützt Timeboxing, Beteiligung und Gesprächsqualität, damit das Meeting nicht in Schuldzuweisung, Off-Topic oder politische Debatten rutscht. In kleinen Teams kann der Product Owner auch allein moderieren, doch das gelingt nur, wenn Moderationskompetenz vorhanden ist und Stakeholder-Dynamik überschaubar bleibt. Das richtige Setup erkennst du daran, dass die Sprint Review regelmäßig verwertbares Feedback erzeugt und der Product Backlog danach sichtbar angepasst ist.

Sollte man die Sprint Review absagen, wenn das Sprint Goal nicht erreicht wurde?

Eine Sprint Review abzusagen, weil das Sprint Goal verfehlt wurde, ist meist kontraproduktiv, weil gerade dann Inspection und Adaptation am wichtigsten sind. Die Review ermöglicht, transparent zu zeigen, was wirklich „Done“ ist, welche Blockaden aufgetreten sind und welche Konsequenzen das für Prioritäten oder Risiken hat. Wenn du absagst, entsteht ein Transparenzloch, Stakeholder treffen Entscheidungen ohne aktuelle Evidenz und das Team verliert eine strukturierte Gelegenheit zur Neuausrichtung. Du kannst den Ablauf anpassen, indem du Demo-Zeit reduzierst und die Diskussion auf Risiken, Abhängigkeiten und die wertvollsten nächsten Schritte fokussierst. Eine reife Sprint Review behandelt Rückschläge als Lernsignal und übersetzt dieses Signal in konkrete Backlog-Anpassungen, statt die Realität zu verstecken.

Wie macht man Sprint Reviews nützlich für Stakeholder, die „keine Zeit“ haben?

Stakeholder haben meist nicht zu wenig Zeit, sondern zu wenig wahrgenommenen Nutzen, und genau dort setzt die Verbesserung der Sprint Review an. Du verkürzt die Sitzung, indem du nur das zeigst, wofür Feedback oder Entscheidungen gebraucht werden, und du vermeidest vollständige Walkthroughs, die keine Richtung ändern. Du veröffentlichst eine Agenda mit klaren Entscheidungspunkten, damit Stakeholder sofort erkennen, warum ihre Anwesenheit Wirkung hat und welche Art Input erwartet wird. Du demonstrierst über reale Nutzerflüsse und schließt mit einer sichtbaren Zusammenfassung der Backlog-Änderungen, weil diese Sichtbarkeit die Motivation zur Teilnahme stark erhöht. Wenn dennoch Widerstand bleibt, fokussierst du die Einladungsliste auf Personen mit relevantem Wissen oder Mandat, denn ein kleiner Kreis mit echter Entscheidungskraft ist oft wirksamer als eine große Runde ohne Konsequenz.