Sprint Review : guide complet 2026 pour réussir la revue de sprint Scrum, obtenir du feedback utile et piloter le Product Backlog

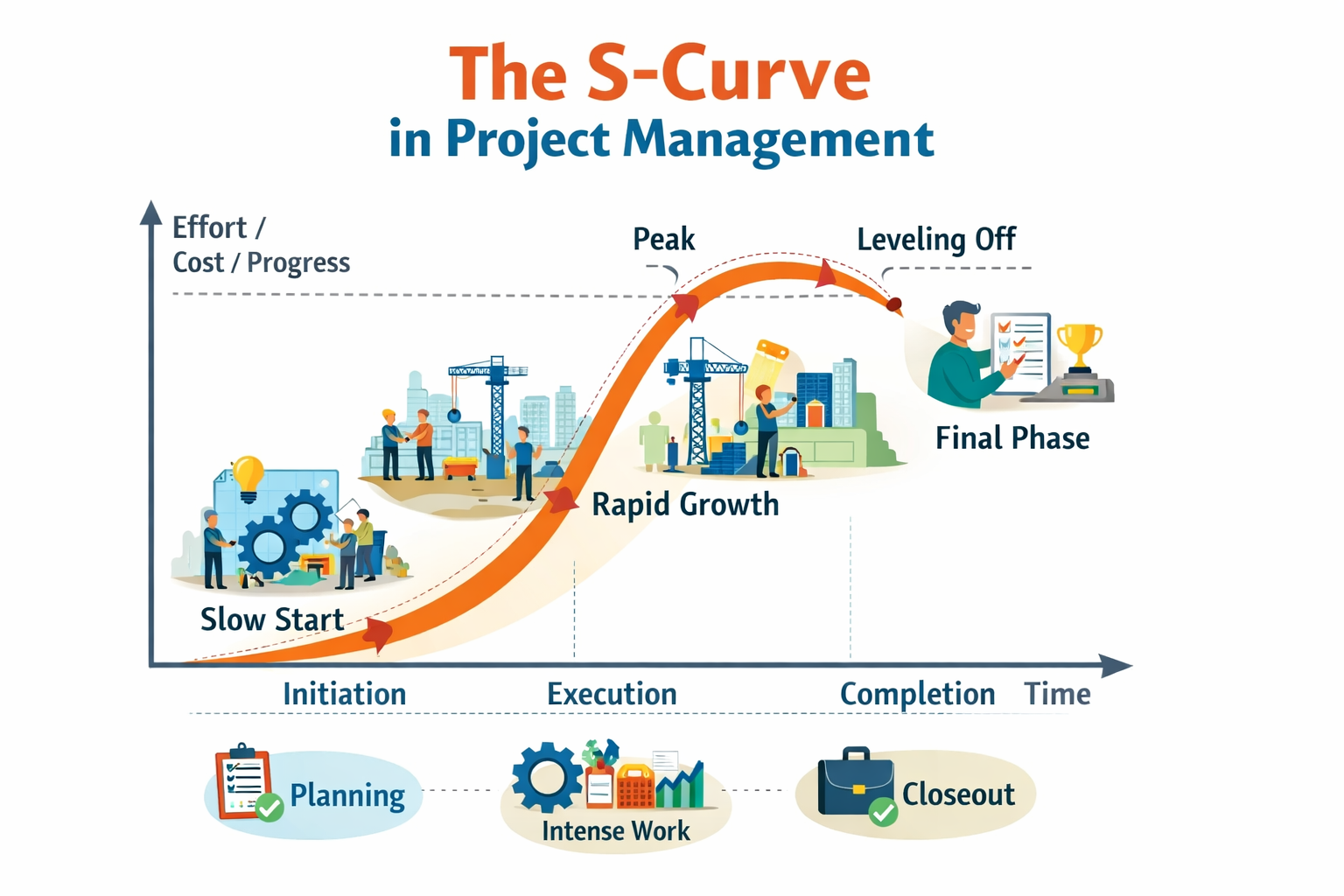

La Sprint Review est l’événement Scrum qui sert à inspecter l’incrément livré pendant le Sprint et à adapter la suite en fonction du feedback réel, du contexte marché et des priorités produit. Elle ne vise pas à “faire une démo” pour cocher une case, mais à créer une conversation structurée entre la Scrum Team et les parties prenantes afin de décider ce qui a le plus de valeur à faire ensuite. Une Sprint Review bien menée clarifie la progression vers le Product Goal, met en évidence les apprentissages, fait remonter les risques, et aligne tout le monde sur un plan de livraison crédible. En 2026, la pression sur le time-to-market et la multiplication des dépendances rendent ce moment encore plus stratégique : sans revue efficace, le Product Backlog se remplit d’hypothèses non testées, le produit dérive, et l’équipe perd la confiance des stakeholders.

Comprendre la Sprint Review : définition, finalité et résultats attendus

Une Sprint Review réussie produit un résultat concret : un Product Backlog ajusté, plus pertinent, et un alignement clair sur les prochaines décisions. Concrètement, l’équipe présente un incrément “Done” et discute avec les stakeholders de ce que cela change, de ce qui manque, et de ce que le marché ou l’organisation a appris depuis le dernier Sprint. L’objectif central reste l’inspection et l’adaptation, ce qui implique d’accueillir le feedback, y compris lorsqu’il contredit une hypothèse de départ. La Sprint Review devient alors un mécanisme de gouvernance produit léger : elle remplace les comités lourds par une preuve tangible, des échanges orientés valeur, et des arbitrages basés sur des signaux. Quand elle fonctionne, elle réduit les surprises, évite la surproduction, et transforme la roadmap en trajectoire vivante plutôt qu’en promesse figée.

Ce que la Sprint Review n’est pas : trois confusions qui ruinent la valeur

Beaucoup d’équipes sabotent la Sprint Review en la confondant avec une réunion de statut, une validation qualité, ou une cérémonie de communication descendante. Une revue de sprint n’est pas un “reporting” où l’on commente des tickets, car ce format pousse à justifier plutôt qu’à apprendre, et il tue l’engagement des stakeholders. Elle n’est pas non plus une réunion d’acceptation, car l’acceptation découle d’une Definition of Done claire et d’un incrément conforme, pas d’un vote en séance. Enfin, elle ne doit pas devenir une présentation PowerPoint “produit fini” : les parties prenantes veulent comprendre l’impact, manipuler, questionner et aider à prioriser, pas admirer des slides. Dès que la review se transforme en spectacle, l’équipe perd le feedback utile et le Product Backlog cesse d’être un outil d’adaptation pour devenir une liste de souhaits.

Intention et valeur business : pourquoi la Sprint Review influence directement la performance produit

La Sprint Review relie l’exécution de l’équipe à la réalité business, ce qui en fait un levier de performance plus puissant qu’un simple rituel Scrum. En montrant un incrément opérationnel, tu remplaces les opinions par des faits, et tu accélères les décisions de priorisation, de découpage, de lancement ou d’abandon. Cette dynamique protège aussi l’équipe : un backlog réorienté tôt coûte moins cher qu’un pivot tardif, et un risque dévoilé en review coûte moins qu’un incident client. Une Sprint Review efficace améliore la relation avec les stakeholders, car elle installe un cadre de transparence où chacun comprend les arbitrages, les contraintes et la logique de valeur. En 2026, cet effet s’amplifie avec la complexité des produits numériques : plus le système est interconnecté, plus le feedback rapide devient une condition de survie, et la Sprint Review reste le point de convergence le plus simple pour l’organiser.

La règle d’or : sortir de la logique “livrer plus” pour entrer dans la logique “apprendre plus vite”

Une Sprint Review forte maximise l’apprentissage, pas la quantité de fonctionnalités montrées, et ce changement de posture transforme la qualité des décisions. Tu cherches à valider une hypothèse, mesurer une réaction, clarifier une contrainte métier, ou détecter un décalage avec un besoin utilisateur, puis tu traduis ces signaux en ajustements du Product Backlog. Cette logique réduit la tentation d’empiler des user stories “juste au cas où”, car chaque item doit justifier sa présence par un lien clair avec un objectif, une valeur ou un risque. Elle évite aussi le piège du “Sprint accounting” où l’on montre tout, y compris des détails sans intérêt, ce qui fatigue l’audience et dilue les messages importants. Quand tu conçois la review comme un atelier de décision, tu obtiens moins d’avis vagues et plus d’informations actionnables, donc un backlog plus net et une roadmap plus crédible.

Participants, rôles et responsabilités : qui doit être là et pourquoi

La Sprint Review exige les bonnes personnes, car sans décideurs et sans utilisateurs ou représentants métier, tu obtiens du feedback superficiel. La Scrum Team est indispensable : les Developers portent la réalité technique, le Product Owner porte la valeur et les arbitrages, et le Scrum Master protège le cadre et la dynamique. Les parties prenantes doivent représenter la valeur : business owners, marketing, support, sales, operations, conformité, ou tout acteur qui subit ou bénéficie du produit. L’erreur classique consiste à inviter trop de monde “pour la forme” tout en oubliant ceux qui peuvent décider, valider un besoin, ou apporter une contrainte critique. Une review utile ressemble à une petite coalition capable d’orienter le produit sur la base de preuves, et non à une salle pleine de spectateurs sans capacité d’action.

Qui présente et qui “démontre” : modèle de distribution efficace

Tu gagnes en impact quand tu choisis consciemment qui présente quoi, plutôt que de laisser la review devenir un monologue improvisé. Le Product Owner introduit souvent le contexte, rappelle l’objectif de Sprint et la logique de valeur, puis encadre les questions de priorisation. Les Developers démontrent l’incrément, car ils peuvent expliquer les comportements réels, les limites, et les compromis techniques, ce qui augmente la confiance et la qualité du feedback. Le Scrum Master facilite : il gère le temps, reformule les demandes, évite les débats hors-sujet et sécurise la participation des stakeholders. Ce trio fonctionne particulièrement bien quand le produit a des enjeux transverses, car chacun parle depuis sa responsabilité, et l’audience comprend rapidement où se prennent les décisions et comment contribuer utilement.

Timebox et cadence : calibrer la durée pour garder de l’énergie et produire des décisions

La Sprint Review est timeboxée, et ce détail a une conséquence stratégique : le temps limité force l’équipe à sélectionner ce qui compte vraiment pour la valeur et l’apprentissage. Pour un Sprint d’un mois, la durée maximale est de 4 heures, et tu ajustes proportionnellement pour des Sprints plus courts afin de préserver l’attention et la qualité du feedback. Cette donnée quantitative sert de garde-fou : si tu dépasses régulièrement, c’est souvent que tu montres trop de choses, que tu n’as pas préparé les points de discussion, ou que tu laisses la réunion dériver vers de la résolution de problèmes. Une review bien calibrée laisse suffisamment de place aux questions et à la discussion, tout en restant assez courte pour que les stakeholders aient envie de revenir. En pratique, la qualité d’une Sprint Review se voit à sa capacité à produire un backlog ajusté en respectant le temps de chacun.

Choisir la bonne cadence d’invitation : stabilité, régularité et signal produit

La régularité de la Sprint Review crée un signal fort dans l’organisation, car elle montre que le produit progresse par incréments et que les décisions s’appuient sur des preuves. Tu stabilises l’invitation pour éviter l’effet “réunion surprise” et pour installer un rendez-vous attendu, ce qui augmente la présence des personnes clés. Tu adaptes ensuite la composition selon le sujet : certaines reviews méritent des experts sécurité, conformité ou finance, alors que d’autres nécessitent plutôt support et sales pour capter la réalité du terrain. Cette approche évite d’inonder tout le monde, tout en garantissant que les bonnes contraintes et opportunités remontent au bon moment. En 2026, l’hybride et le remote rendent cette discipline encore plus importante : une invitation stable, un ordre du jour clair et des livrables accessibles font souvent la différence entre un feedback riche et une réunion silencieuse.

Préparation : la phase qui détermine 80% de la qualité d’une Sprint Review

La plupart des Sprint Reviews médiocres échouent avant même de commencer, parce que l’équipe arrive sans cadrage, sans sélection, et sans histoire produit. Une préparation solide commence par vérifier que ce qui sera montré respecte la Definition of Done, car rien ne détruit plus vite la confiance qu’un incrément instable ou incomplet présenté comme “presque prêt”. Ensuite, tu choisis ce que tu veux apprendre : quels retours sont nécessaires pour décider de la suite, quelles hypothèses doivent être testées, et quelles contraintes doivent être clarifiées. Tu prépares un fil conducteur orienté valeur, afin que chaque démonstration réponde à une question simple : “qu’est-ce que cela change pour l’utilisateur ou pour le business ?”. Enfin, tu anticipes la capture du feedback et sa transformation en backlog, sinon la review produit des discussions intéressantes qui ne se matérialisent jamais en décisions.

Checklist de préparation opérationnelle : un standard simple et répétable

Une checklist réduit la charge mentale et sécurise la qualité, surtout quand l’équipe change, que le produit grandit, ou que les stakeholders tournent. Avant la Sprint Review, tu confirmes les éléments “Done”, tu prépares un environnement de démo fiable, et tu t’assures que les scénarios de démonstration couvrent la valeur et les cas limites importants. Tu identifies les décisions attendues, par exemple une priorisation, un pivot, un ajustement de scope, ou un arbitrage sur la dette technique, afin de guider les échanges vers un résultat. Tu prépares aussi trois questions ouvertes qui encouragent un feedback utile plutôt que des avis génériques, comme “qu’est-ce qui manque pour un usage réel ?” ou “qu’est-ce qui bloque la mise en production ?”. Enfin, tu prévois un mécanisme de capture, par exemple un canal dédié, une section du backlog, ou un tableau visible, pour transformer immédiatement les apprentissages en actions.

- Vérifier l’incrément : conformité à la Definition of Done, stabilité, données de test, accès.

- Sélectionner ce qui mérite feedback : valeur, risque, inconnue, dépendance, impact utilisateur.

- Préparer un scénario de démonstration orienté “usage” et non “fonctionnalités”.

- Clarifier les décisions recherchées : priorisation, lancement, itération, abandon, dette, conformité.

- Organiser la capture : questions, notes, actions, et mise à jour du Product Backlog.

Déroulé recommandé : un agenda de Sprint Review qui maximise le feedback utile

Un bon agenda de Sprint Review protège le temps, structure la discussion et garde l’audience engagée, sans transformer la réunion en scénario rigide. Tu démarres par un rappel du Product Goal et de l’objectif du Sprint, puis tu poses clairement ce qui sera montré et ce qui ne le sera pas, afin d’éviter les digressions et les attentes irréalistes. Tu enchaînes avec la démonstration de l’incrément, mais tu privilégies des parcours utilisateur concrets, car ils déclenchent des retours plus riches que l’énumération de user stories. Tu réserves ensuite un temps explicite au feedback et à la discussion sur “ce qui change” pour la suite, car c’est là que la valeur de la review se crée. Tu termines par la mise à jour des prochaines priorités, en confirmant ce qui sera exploré ou livré au prochain Sprint et ce qui nécessite une analyse complémentaire.

Script de facilitation : questions qui transforment une démo en conversation produit

Les questions que tu poses déterminent la profondeur du feedback, et une Sprint Review sans questions structurées produit souvent des retours vagues et peu exploitables. Tu peux guider l’audience vers l’essentiel avec des questions liées à la valeur, à l’usage et au risque, plutôt que des questions techniques ou de calendrier trop tôt. Par exemple, tu demandes ce qui empêche un usage réel, ce qui surprend, ce qui manque pour passer à l’échelle, ou ce qui doit être clarifié avant d’investir davantage. Tu encourages les stakeholders à relier leurs remarques au Product Goal, car cela réduit les demandes opportunistes et aide à arbitrer. Enfin, tu clarifies le statut des décisions : certaines sont immédiates et réversibles, d’autres demandent une analyse, et ta facilitation doit protéger l’équipe contre la pression de “dire oui” en séance.

Transformer le feedback en Product Backlog : méthodes concrètes pour éviter la “review sans suite”

Le feedback n’a de valeur que s’il se transforme en décisions et en actions, et c’est précisément là que beaucoup de Sprint Reviews échouent. Tu dois distinguer trois catégories : les retours qui confirment une direction, ceux qui révèlent une lacune à corriger rapidement, et ceux qui ouvrent une opportunité nécessitant exploration. Ensuite, tu traduis ces retours en éléments de backlog correctement formulés, avec un objectif clair, un critère de succès, et un lien explicite à la valeur ou au risque. Tu évites de convertir chaque suggestion en user story, car certaines remarques doivent devenir une hypothèse, un spike, un test utilisateur, ou une contrainte non fonctionnelle. Enfin, tu clôtures la review en montrant comment le backlog évolue, car cette transparence renforce la confiance et incite les parties prenantes à donner un feedback plus responsable lors des prochaines Sprint Reviews.

Décider en séance ou décider après : un cadre simple pour arbitrer sans chaos

Une Sprint Review efficace sait décider, mais elle sait aussi différer intelligemment, et cette capacité protège la qualité des choix. Tu peux décider en séance lorsque l’information est suffisante, que la décision est réversible, et que les personnes nécessaires sont présentes, par exemple pour ajuster l’ordre de deux items ou clarifier une contrainte métier. Tu diffères lorsque la décision est lourde, irréversible, ou quand elle exige des données supplémentaires, comme une analyse d’impact technique, une validation juridique, ou un retour utilisateur plus large. Ce cadre évite le piège des engagements pris sous pression, qui se transforment ensuite en frustration et en rework. En sortie de review, tu captures clairement ce qui est décidé, ce qui est à explorer, et ce qui est bloqué, afin que le Product Owner et l’équipe puissent avancer sans ambiguïté.

Best practices 2026 : rendre la Sprint Review vivante, utile et orientée décision

En 2026, une Sprint Review performante se reconnaît à trois qualités : elle fait manipuler le produit, elle structure la discussion, et elle produit des adaptations visibles. Tu privilégies les démonstrations “hands-on”, même simples, parce qu’elles révèlent des frictions que personne ne verbalise sur des slides. Tu visualises la progression vers le Product Goal avec des indicateurs compréhensibles, afin de replacer chaque incrément dans une trajectoire, pas dans un catalogue de fonctionnalités. Tu encourages les stakeholders à exprimer leurs retours sous forme de besoins, de risques et de résultats attendus, plutôt que de solutions imposées, ce qui préserve la responsabilité de conception de l’équipe. Enfin, tu protèges la réunion des sujets hors périmètre en notant les points “parking lot” et en les traitant ensuite, pour conserver une Sprint Review énergique et centrée sur la valeur.

Utiliser l’IA sans dégrader la qualité du feedback : une opportunité réelle en 2026

Les pratiques évoluent rapidement, et les équipes Agile utilisent de plus en plus des outils d’assistance pour préparer, documenter et exploiter les Sprint Reviews. Une statistique utile pour situer le contexte : le AI4Agile Practitioners Report 2026 publié en 2026 indique que 67% des organisations donnent déjà accès à des outils d’IA, ce qui ouvre des usages concrets autour des rituels et de la gestion du backlog. Tu peux exploiter l’IA pour résumer les retours, regrouper les thèmes, proposer des formulations d’items de backlog, ou suggérer des questions à poser, à condition de garder la responsabilité humaine sur l’arbitrage. L’enjeu consiste à éviter le “feedback automatique” qui lisse les nuances et transforme des signaux faibles en phrases génériques. Une bonne pratique consiste à utiliser l’IA comme assistant de synthèse, puis à valider chaque point avec la source, le contexte et la décision attendue, afin de renforcer l’apprentissage sans trahir la réalité.

Anti-patterns : erreurs fréquentes et correctifs pour sauver une Sprint Review

Les anti-patterns de Sprint Review reviennent avec une régularité frappante, et ils ont tous le même effet : ils coupent le lien entre l’incrément, le feedback et l’adaptation du backlog. Le premier est la “death by PowerPoint”, où l’équipe raconte au lieu de montrer, ce qui produit des discussions abstraites et peu fiables. Le second est la review transformée en gate d’acceptation, qui réintroduit une gouvernance lourde et déresponsabilise la Definition of Done, tout en créant une pression malsaine sur l’équipe. Le troisième est la démonstration exhaustive, qui fatigue l’audience et fait disparaître les sujets à forte valeur ou à fort risque dans un flux de détails. Le correctif consiste à cadrer la review comme un atelier, à sélectionner ce qui mérite feedback, et à formaliser un mécanisme de capture qui transforme les retours en backlog et en décisions visibles.

Symptômes, causes, actions : diagnostic rapide en situation

Tu peux diagnostiquer une Sprint Review en écoutant les signaux faibles, car ils révèlent presque toujours un problème de cadrage ou de confiance. Si les stakeholders n’ont plus le temps de venir, la cause est souvent un manque de valeur perçue, lié à des démos trop longues ou à des discussions sans suite, et l’action prioritaire est de raccourcir, sélectionner et conclure par des décisions. Si l’équipe se justifie et se défend, la cause provient souvent d’un environnement où la review sert à juger plutôt qu’à apprendre, et l’action consiste à recadrer le but sur l’inspection et l’adaptation, avec des questions orientées résultat. Si les demandes explosent en séance, la cause est souvent l’absence de limites et de critères de priorité, et l’action consiste à relier chaque idée au Product Goal et à différer l’arbitrage lorsqu’il manque des données. Ce diagnostic rapide évite de “changer l’agenda” au hasard et permet d’améliorer la Sprint Review de Sprint en Sprint.

Sprint Review vs Sprint Retrospective : différences nettes pour éviter les réunions hybrides inefficaces

Confondre Sprint Review et Sprint Retrospective crée des réunions hybrides où personne ne sait quoi attendre, et cette confusion détruit la qualité des échanges. La Sprint Review se concentre sur le produit, l’incrément, la valeur, le contexte et l’adaptation du Product Backlog, avec une présence active des parties prenantes. La rétrospective se concentre sur la manière de travailler de la Scrum Team, ses interactions, ses outils, ses difficultés, et les améliorations de processus, généralement sans audience externe. Quand tu mélanges les deux, tu obtiens soit une review trop interne qui n’apporte pas de feedback business, soit une rétro trop exposée où l’équipe n’ose plus parler des vrais problèmes. La meilleure approche consiste à protéger l’identité de chaque événement : la review pour apprendre sur le produit et décider de la suite, la rétro pour améliorer la capacité de l’équipe à produire un incrément de qualité.

Mesurer l’efficacité d’une Sprint Review : scorecard simple et indicateurs actionnables

Mesurer une Sprint Review ne signifie pas la bureaucratiser, mais vérifier qu’elle produit réellement de l’adaptation et de la valeur. Une scorecard simple peut suivre la présence des stakeholders clés, la qualité du feedback, la clarté des décisions, et le taux de transformation des retours en actions backlog. Tu peux aussi observer le ratio entre temps de démonstration et temps de discussion, car une review trop “show” produit souvent moins de décisions qu’une review “talk”. Un autre signal utile est la stabilité du Product Backlog après la review : si rien ne bouge jamais, soit le produit n’apprend rien, soit la réunion n’ose pas remettre en cause les choix. Enfin, tu peux suivre la satisfaction qualitative des participants, non pas via une note vague, mais via une question ciblée comme “quelle décision avons-nous pu prendre aujourd’hui grâce à l’incrément ?”, car cette formulation révèle immédiatement la valeur réelle de la Sprint Review.

Exemple de scorecard en 5 critères : lisible, mobile et orientée amélioration

Une scorecard courte tient sur mobile et se remplit en deux minutes, ce qui augmente la probabilité qu’elle soit utilisée Sprint après Sprint. Tu peux noter, sur une échelle simple, la clarté du Product Goal rappelé en début de review, l’utilité du feedback obtenu, la qualité de la démonstration orientée usage, la qualité des décisions prises ou cadrées, et la mise à jour visible du Product Backlog. L’intérêt n’est pas de “surveiller” mais de créer un rituel d’amélioration continue autour de la review elle-même, au même titre que la rétrospective améliore l’exécution. En observant ces critères, tu détectes rapidement les dérives, comme un excès de présentations, une perte d’engagement des parties prenantes, ou une incapacité à trancher. Ce format te donne un point de départ concret pour ajuster la facilitation, la préparation, et la sélection des sujets, sans alourdir la vie de l’équipe.

Cas pratiques : adapter la Sprint Review selon le contexte (B2B, produit complexe, multi-équipes, remote)

Une Sprint Review efficace respecte les principes, mais elle s’adapte au contexte, car les contraintes diffèrent fortement entre un produit B2C, un SaaS B2B, une plateforme interne ou un système critique. En B2B, tu privilégies souvent des scénarios orientés compte client, intégration et adoption, car la valeur se joue sur le workflow et le déploiement. Sur un produit complexe, tu structures la review par thèmes de valeur ou par risques, plutôt que par composants techniques, afin que les stakeholders comprennent l’impact sans se perdre dans l’architecture. En multi-équipes, tu évites la “parade de démos” en désignant un fil conducteur produit, puis en montrant seulement les incréments qui changent une expérience ou un objectif, même si plusieurs équipes contribuent. En remote, tu investis dans la qualité de l’environnement de démonstration et dans la collecte de feedback, car la friction technique peut faire disparaître la discussion, alors que la discussion est précisément la partie la plus précieuse de la Sprint Review.

Multi-stakeholders : éviter la réunion “forum” et préserver la capacité à décider

Quand plusieurs départements participent, la Sprint Review risque de se transformer en forum où chacun pousse ses priorités, ce qui dilue la valeur et fatigue l’équipe. Tu limites ce risque en rappelant explicitement le Product Goal et en utilisant des critères de priorisation communs, comme l’impact utilisateur, le revenu, la réduction de risque ou la conformité. Tu définis une règle claire : toute idée est la bienvenue, mais elle doit être formulée en problème ou en résultat attendu, et non en solution imposée, afin de préserver la qualité de la conception. Tu peux aussi prévoir un canal de collecte asynchrone pour les demandes détaillées, afin de garder la review centrée sur les décisions et l’apprentissage. Enfin, tu termines par une synthèse des décisions, des hypothèses à tester et des points à analyser, car cette clarification empêche la réunion de laisser une impression de “grand débat sans suite”.

Mini FAQ Sprint Review : réponses directes aux questions les plus recherchées

Quelle est la différence entre une Sprint Review et une démo de sprint ?

Une “démo” décrit souvent un moment où l’équipe montre ce qu’elle a fait, alors que la Sprint Review vise à déclencher une discussion pour inspecter l’incrément et adapter la suite. Quand tu fais une simple démo, tu obtiens des réactions superficielles, parce que l’audience n’a ni cadre ni objectif de décision. Dans une Sprint Review, tu montres pour apprendre, tu poses des questions orientées valeur, et tu transformes le feedback en ajustements du Product Backlog. Cette différence se voit dans le résultat : une démo se termine par des applaudissements, une Sprint Review se termine par des décisions, des hypothèses, et une priorisation clarifiée. Si tu veux un repère simple, retiens que la review est un atelier de pilotage produit, pas un spectacle.

Qui doit animer la Sprint Review en Scrum : Product Owner ou Scrum Master ?

Le Product Owner porte la responsabilité de maximiser la valeur et de piloter le Product Backlog, donc il conduit souvent la partie “contexte, objectifs, décisions”. Le Scrum Master porte la responsabilité du cadre Scrum et de l’efficacité des événements, donc il facilite fréquemment la dynamique, le temps et la qualité de la conversation. Cette répartition fonctionne très bien : le PO garde le leadership produit, et le Scrum Master protège la qualité de la réunion et l’engagement des participants. Dans certains contextes, le PO anime entièrement, mais il doit alors faire attention à ne pas perdre la facilitation, surtout si les stakeholders sont nombreux ou si la tension est élevée. Le bon choix se mesure à un critère : l’animation doit produire du feedback exploitable et un backlog réellement adapté.

Que faire si le Sprint Goal n’est pas atteint : annuler la Sprint Review ?

Tu ne devrais pas annuler la Sprint Review lorsque l’objectif n’est pas atteint, car c’est précisément dans ces moments que l’inspection et l’adaptation deviennent les plus importantes. La review permet d’expliquer ce qui est réellement “Done”, de clarifier ce qui bloque, de partager les apprentissages, et de discuter des options pour la suite avec les parties prenantes. Si tu annules, tu crées un trou de transparence, tu encourages la dissimulation involontaire, et tu perds l’occasion d’ajuster le plan avant que les coûts n’augmentent. Tu peux adapter le format en réduisant la démonstration et en augmentant la discussion sur les risques, les dépendances et les décisions nécessaires. Une Sprint Review mature assume la réalité et la transforme en actions, au lieu de protéger les apparences.

Comment rendre une Sprint Review plus utile aux stakeholders qui “n’ont pas le temps” ?

Les stakeholders manquent rarement de temps, ils manquent de valeur perçue, et c’est sur ce point que tu dois agir pour améliorer ta Sprint Review. Tu commences par réduire la durée et par sélectionner uniquement les incréments qui demandent un feedback ou une décision, afin d’éviter l’ennui et la surcharge d’informations. Tu annonces clairement ce qui sera discuté et ce que tu attends comme contribution, car les participants viennent plus volontiers lorsqu’ils comprennent leur rôle et l’impact de leur présence. Tu privilégies des scénarios utilisateur concrets et tu termines par une synthèse des décisions et des adaptations du Product Backlog, afin que chacun voie le lien entre sa contribution et les choix du produit. Enfin, tu invites les bonnes personnes plutôt que tout le monde, car une présence ciblée augmente la qualité des échanges et la sensation d’utilité.